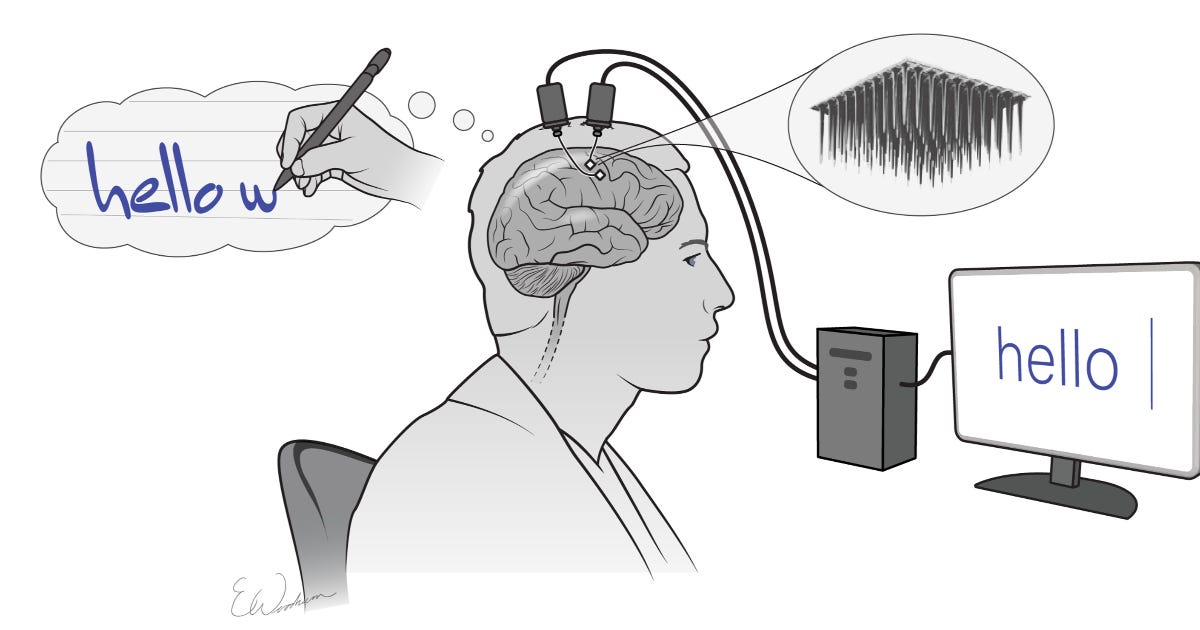

Het systeem maakt gebruik van twee sets geïmplanteerde elektroden die de hersenactiviteit registreren die wordt geproduceerd door na te denken over het schrijven van brieven. Deze informatie wordt vervolgens in realtime verzameld en verwerkt door een computer, die die gegevens op het scherm omzet in woorden.

Shinoy Lab / Erica Woodrum

Mensen zijn altijd al gefascineerd geweest door het idee dat iemand of iets onze gedachten kan lezen – of het nu telepathie, een computer of de kerstman is. Wetenschappers zeggen nu dat ze een systeem hebben ontwikkeld dat machine learning combineert met een brein-computerinterface, of BCI, om het handschrift te lezen dat in de hersenen voorkomt in plaats van op papier.

Een team van wetenschappers werkte met een 65-jarige verlamd vanaf zijn nek, met behulp van sensoren die in zijn hersenen waren geïmplanteerd om neurale activiteit te detecteren die verband houdt met handschrift. Net zoals de vrijwilliger zich het schrijven van brieven voorstelde, werd deze activiteit ingevoerd in een algoritme dat deze in realtime vertaalt in tekst die op het scherm wordt weergegeven.

Details van het experiment worden in ons bestand bewaard Verslag in het huidige nummer van het tijdschrift Nature. Studeer co-auteur Krishna ShinuiEen onderzoeker aan het Howard Hughes Medical Institute aan de Stanford University zegt dat deze methode robuuster lijkt te zijn dan vergelijkbare onderzoeken die hebben geprobeerd Spraakvertaling In plaats van met de hand te schrijven.

“Momenteel kunnen andere onderzoekers ongeveer 50 woorden uit het woordenboek halen met behulp van machine learning-methoden bij het decoderen van spraak,” Shinui. Hij zei in een verklaring. “Door het handschrift van honderden individuele neuronen te gebruiken, kunnen we elke letter schrijven en dus biedt elk woord echt een ‘open vocabulaire’ dat in de meeste situaties van het leven kan worden gebruikt.”

De hoop is dat een dergelijk systeem verlamde mensen in staat stelt om te schrijven en Communiceer efficiënt zonder hun handen te gebruiken. Door Elon Musk gesteunde startup Neuralink Ze is vooral bekend door het werken aan een vergelijkbare techniek voor hersenimplantatie.

“Bedenk eens hoeveel van je dag je op de computer doorbrengt of met iemand anders communiceert”, zei Shinui. “Het herstellen van het vermogen van mensen die hun onafhankelijkheid hebben verloren om met computers en andere dingen om te gaan, is van het grootste belang, en dit is wat dit soort projecten centraal stelt.”

Het systeem is tot dusverre bij slechts één patiënt als een bewijs van concept aangetoond. Het bouwt voort op eerder werk van het Shenoy-team, waarbij deelnemers die met neurale sensoren waren geïmplanteerd, armbewegingen probeerden om een cursor op het scherm te verplaatsen om letters aan te wijzen en te tikken en woorden en zinnen te spellen. Met deze methode konden mensen ongeveer 40 tekens per minuut “typen”, terwijl de nieuwe handschriftmethode snelheden tot 90 tekens per minuut haalde en wordt verondersteld een nieuw record te zijn voor schrijven via BCI.

De onderzoekers merken op dat dit percentage ongeveer hetzelfde is als iemand van dezelfde leeftijd als een 65-jarige deelnemer die op een smartphone typt.

Het systeem pikte berichten op van de hersenen van een verlamde deelnemer terwijl hij zich voorstelde ze te schrijven.

Willett et al. / Nature 2021 / Howard Hughes Medical Institute

“Communicatie is fundamenteel voor hoe we functioneren in de samenleving”, zegt Debara Tucci, directeur van het National Institute on Deafness and Other Communication Disorders, een van de auteurs van het onderzoek. “In de huidige wereld van internetgebaseerde communicatie kunnen mensen met fysieke en ernstige spraakstoornissen te maken krijgen met aanzienlijke communicatiebarrières en mogelijk isolement. We hopen dat deze resultaten de commerciële ontwikkeling van deze nieuwe BCI-technologie zullen aanmoedigen.

Shenoy zou graag zien dat handschrift wordt geïntegreerd in een complexer op BCI gebaseerd systeem dat ook spraak-, signaal- en click-to-scroll-decodering mogelijk maakt, zoals de huidige smartphone-interfaces.

“Het hebben van deze twee of drie modi en schakelen tussen beide is iets dat we van nature doen,” zei hij.

Vervolgens wil het team samenwerken met een deelnemer die niet kan praten of die lijdt aan een neurodegeneratieve aandoening zoals ALS die mensen kan stelen die worstelen met spraak.

“Proud coffee guru. Web pioneer. Internet expert. Social media specialist.”